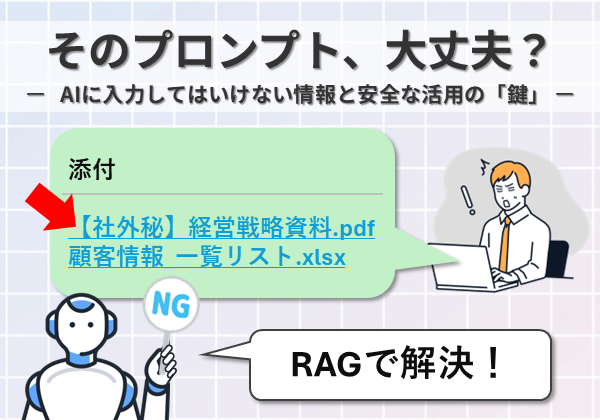

そのプロンプト、大丈夫?AIに入力してはいけない情報と、安全な活用の「鍵」

平素より弊社サービスをご利用いただきまして、ありがとうございます。

[ カスタマーサクセス部 ]の小川です。

前回は、AIを「 新入社員 」に例え、RAG(検索拡張生成)システムを使いこなすための

プロンプトのコツについてお話ししました。

実は、その「 新入社員 」とのやり取りの中で、多くの方が不安に感じていることがあります!

それが、「 AIにどこまで情報を教えていいの? 」というセキュリティの問題です。

今回は、プロンプトに含めるべきではない情報と、それらの機密データを安全に活用するための

「 RAG 」の役割について解説いたします。

■プロンプトに含めない方が良い「 3つの情報 」

一般的な生成AIを利用する際、以下の情報は入力しないのが鉄則です。

(1)個人情報

顧客の氏名、メールアドレス、電話番号など。

(2)機密情報(営業秘密)

未発表のプロジェクト資料、独自の技術、戦略会議の議事録など。

(3)社外秘の内部ルール

公開を想定していない社内規定や人事評価の基準など。

なぜダメなの?と思う方もいらっしゃると思います。

それは、AIサービスでは、入力された情報がAIの「 学習データ 」として再利用される可能性があるためです。

もし機密情報を入力してしまうと、巡り巡って他社のユーザーへの回答にその情報が混ざってしまう…

というリスクがゼロではありません。

■だからこそ「 RAGシステム 」が頼もしい!

「 機密情報が使えないなら、AIで社内資料の要約や分析はできないの? 」と思われるかもしれません。

ここで登場するのが、前回ご紹介したRAG(検索拡張生成)です。

RAGは、AI本体に情報を学習させるのではなく、社内の「 信頼できる情報源 」をその都度見に行く

仕組みです。これにより、AI自体に秘密を教え込むことなく、安全に機密データを活用した回答が

得られるようになります。

つまり、RAGを使えば、「 社外に出せない極秘マニュアル 」を「 新入社員 」にその場だけで

こっそり見せて、仕事をしてもらうといった使い方が可能になります。

■安全に、かつ正確に使いこなすために

RAGシステムを利用すれば情報の安全性は確保されますが、「 正確 」で「 実用性 」の高い回答を

得るためには、前回のテクニックが活きると信じています。

RGC Prompting(構造化プロンプト):

「 提供した社内資料のみを使って回答して 」という「 制約条件 」を課すことで、

AIの妄想(ハルシネーション)を防ぎます。

Chain-of-Thought Prompting(思考の連鎖):

複雑な経緯を持つ議事録から、特定の決定事項とその根拠を抽出したい場合に特に有効です。

前回の記事でも詳しくご紹介していますので、ぜひご覧ください。

https://www.desknets.com/neo/users/media/popular/16179/

■ルールを守って「 最高で最強の相棒 」に

RAGシステムは、社内情報を守りながら活用できる強力なツールです。

「 入力してはいけないもの 」を正しく理解し、適切なプロンプトで指示を出す。

この一工夫で、AIは皆さまの業務を支え、安全で頼もしいパートナーになってくれると思います!

では、またお会いしましょう!

■お問い合わせ先

株式会社 ネオジャパン カスタマーサクセス部

E-mail:csuccess@desknets.com